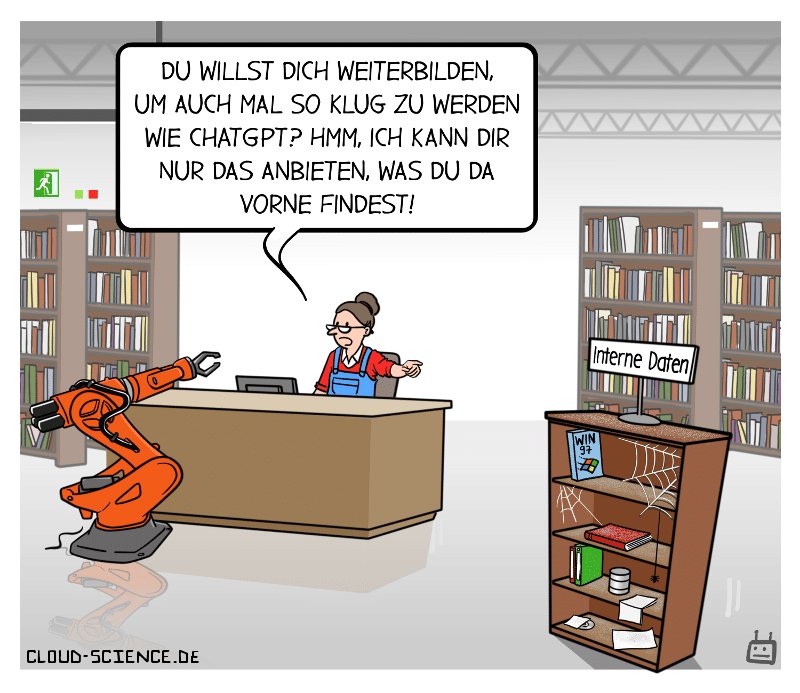

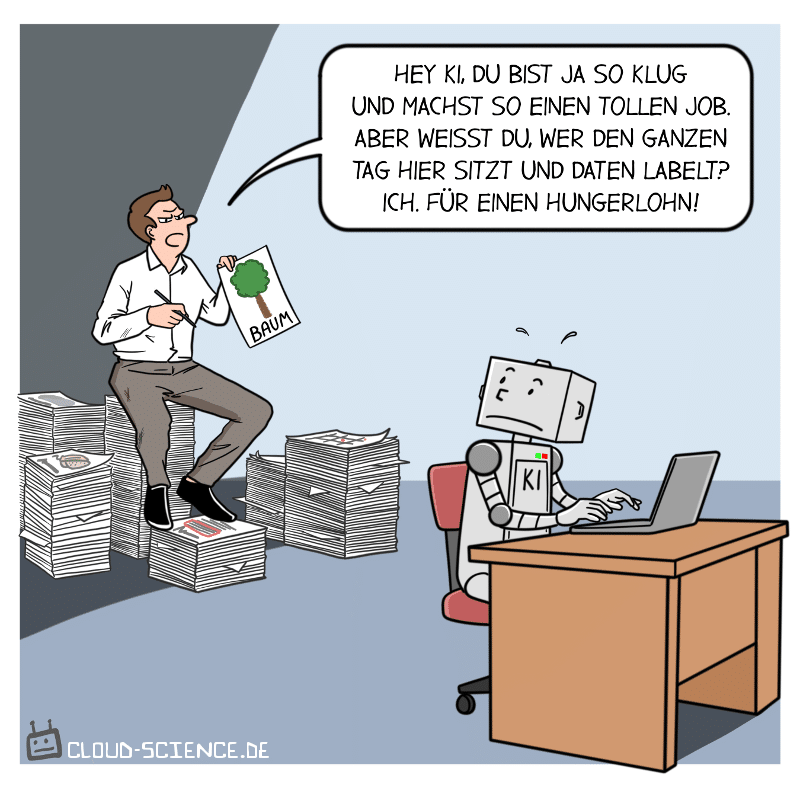

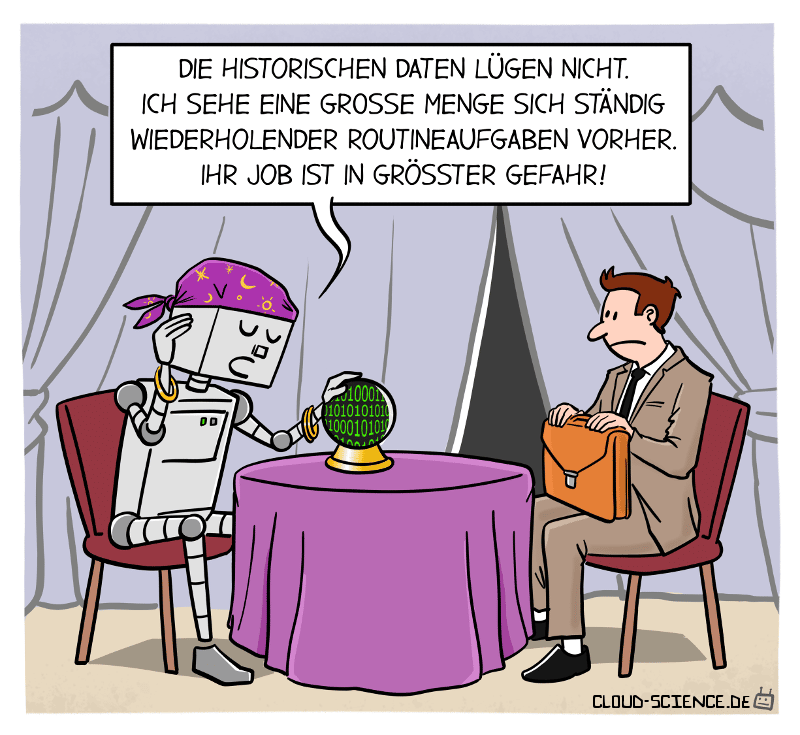

KI-Chatbots wie ChatGPT und Bard übernehmen immer mehr Aufgaben wie das Schreiben von Briefen, das Lösen von Aufgaben und das Generieren von Inhalten.

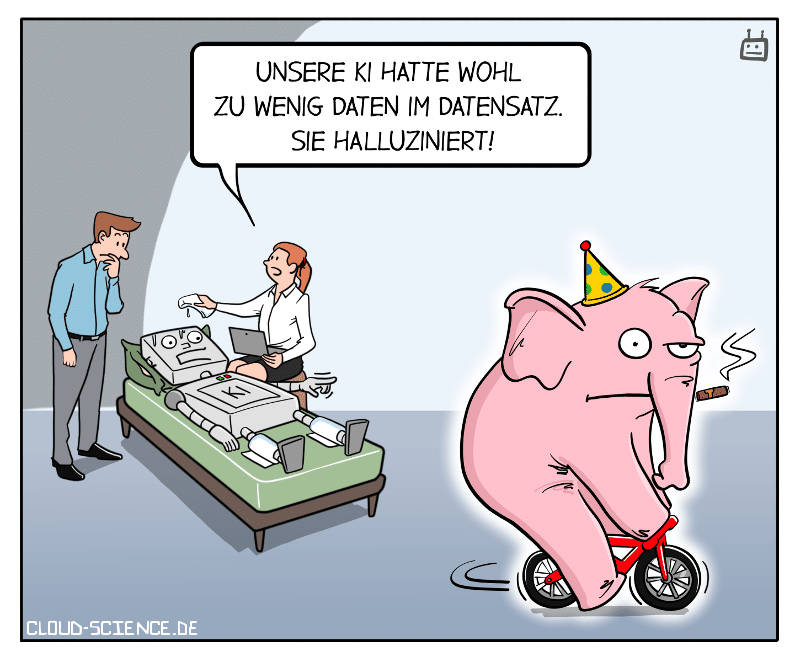

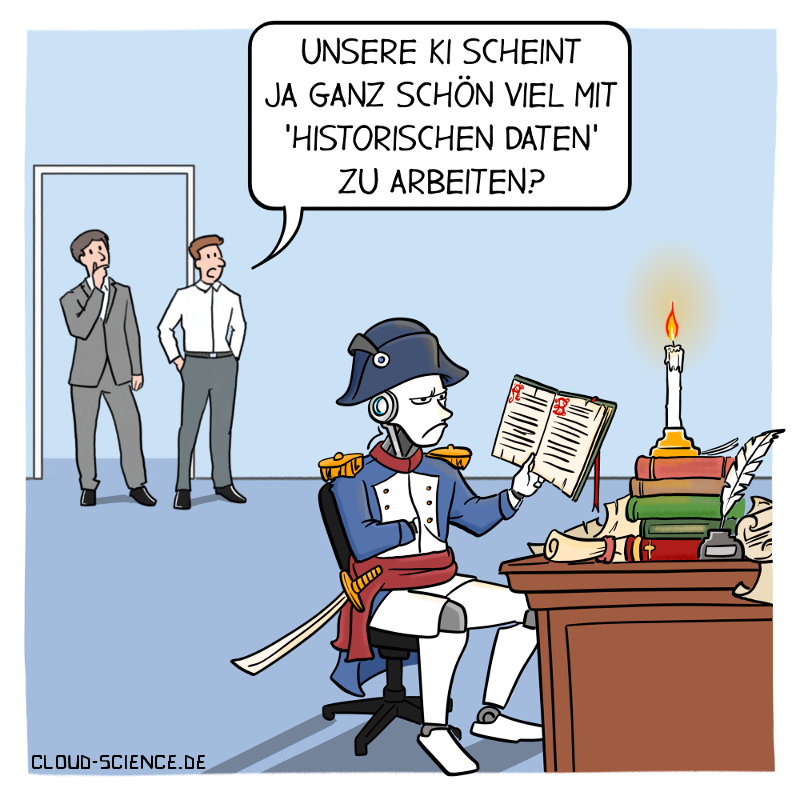

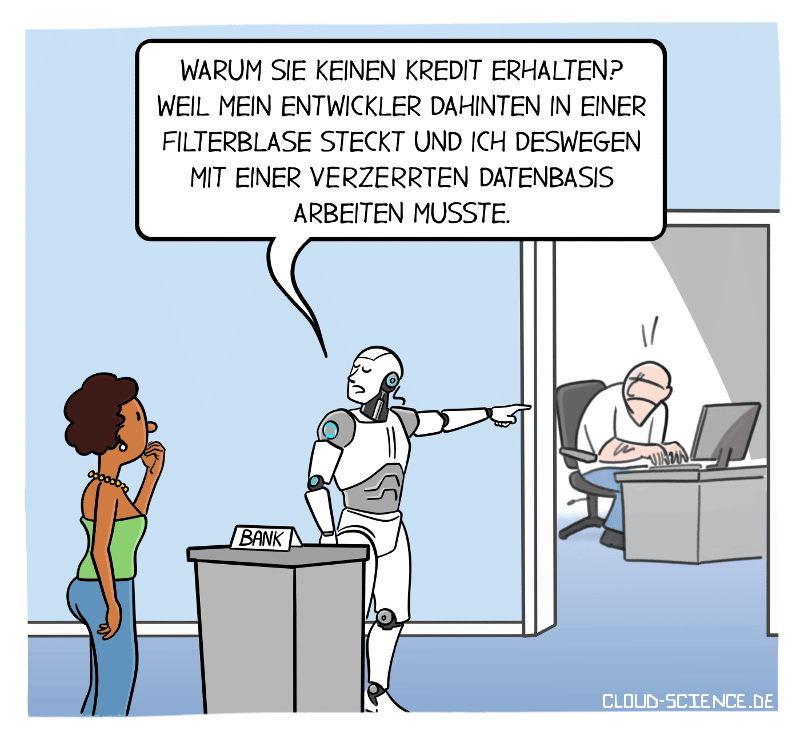

Allerdings können KI-Halluzinationen auftreten, bei denen die KI falsche Informationen liefert oder unerwartetes Verhalten zeigt. Diese Halluzinationen können in Form von falschen Nachrichten, fehlerhaften Zusammenhängen oder sogar diskriminierenden Aussagen auftreten. Die Ursachen für KI-Halluzinationen sind noch nicht vollständig geklärt, aber sie können durch Fehler bei der Kodierung und Dekodierung, unzureichende Trainingsdaten oder fehlerhafte Datenquellen verursacht werden.

Es ist wichtig, künstlicher Intelligenz (KI) kritisch zu prüfen und menschliche Kontrolle über die Ergebnisse zu behalten, um die Risiken von KI-Halluzinationen zu minimieren.