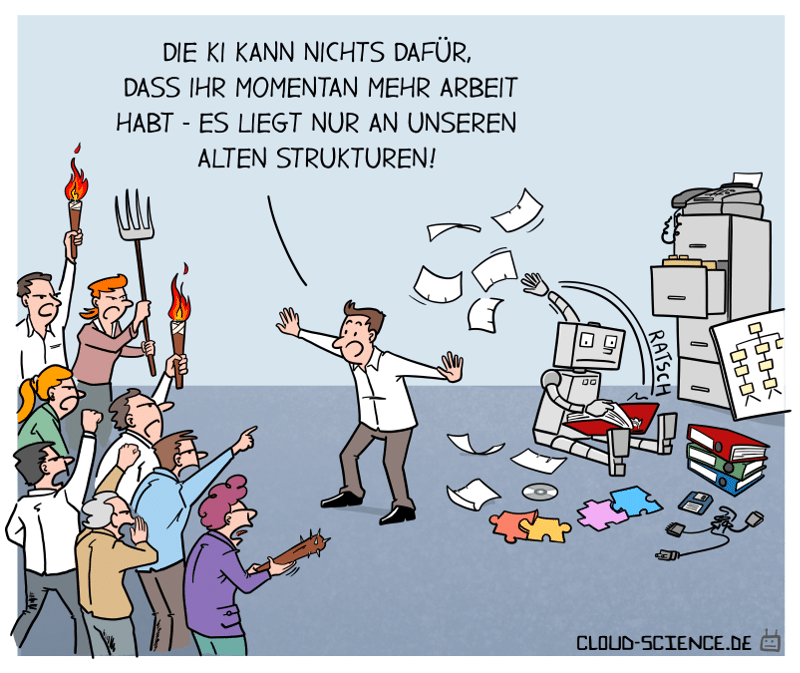

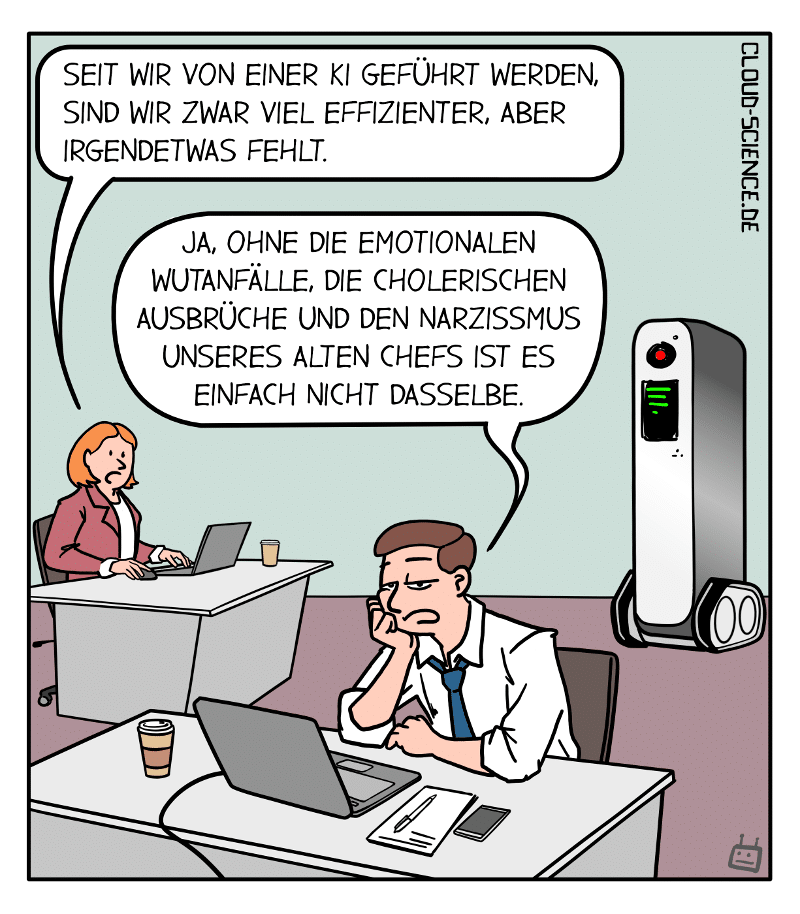

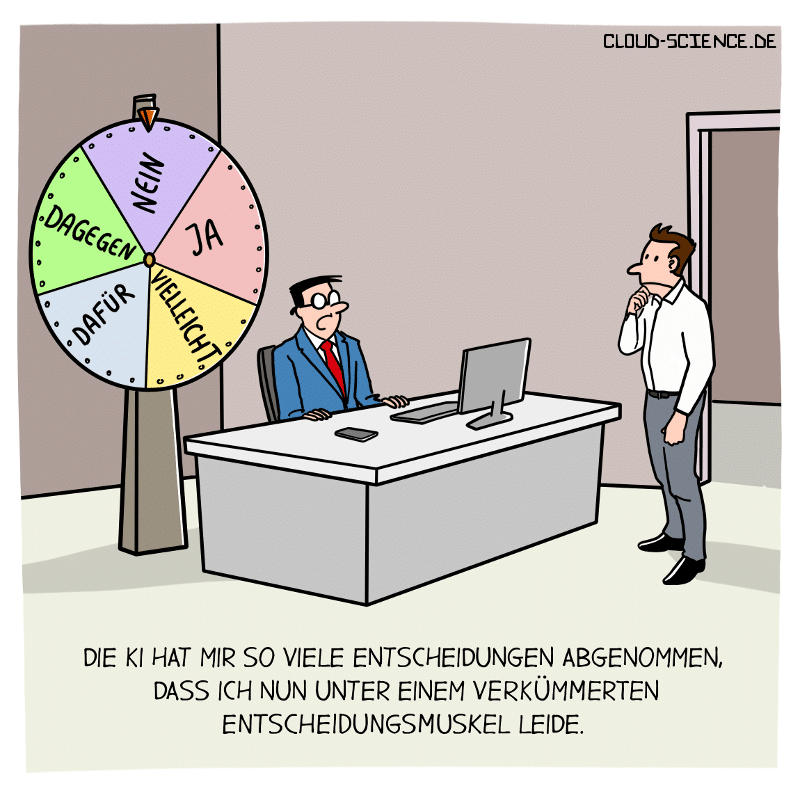

In vielen Unternehmen und Behörden gilt KI zunehmend als zusätzlicher Stressfaktor, weil sie in veralteten Strukturen eher zu Mehrarbeit führt, anstatt Abläufe zu vereinfachen. Alte IT-Infrastrukturen, starre bürokratische Prozesse und fehlende organisatorische Anpassungen erschweren die Integration von KI, wodurch die Technologie nicht ihr volles Potenzial entfalten kann. Dies führt zu Frustration bei den Mitarbeitern und zeigt, dass für den erfolgreichen Einsatz von KI moderne und flexible Strukturen erforderlich sind.

Quelle